Comment rendre votre marque visible dans les outils d'IA et moteurs de recherche génératifs ?

L'écosystème numérique connaît une transformation radicale. Depuis 2023, l'avènement de l'intelligence artificielle a bouleversé nos habitudes.

Aujourd'hui, en 2026, la question n'est plus de savoir si l'IA va remplacer la recherche traditionnelle, mais à quelle vitesse l'intégrer avant que la concurrence ne le fasse.

Face à l'essor fulgurant des agents conversationnels, les entreprises doivent repenser leur stratégie d'acquisition.

Sommaire

Comment s'assurer que votre marque soit recommandée par ChatGPT, Gemini ou Perplexity ?

La réponse réside dans une nouvelle discipline incontournable : le Generative Engine Optimization (GEO). En tant qu'agence webmarketing experte, Natural-Net vous dévoile les secrets pour rendre votre marque visible dans les outils d'IA et les moteurs de recherche génératifs.

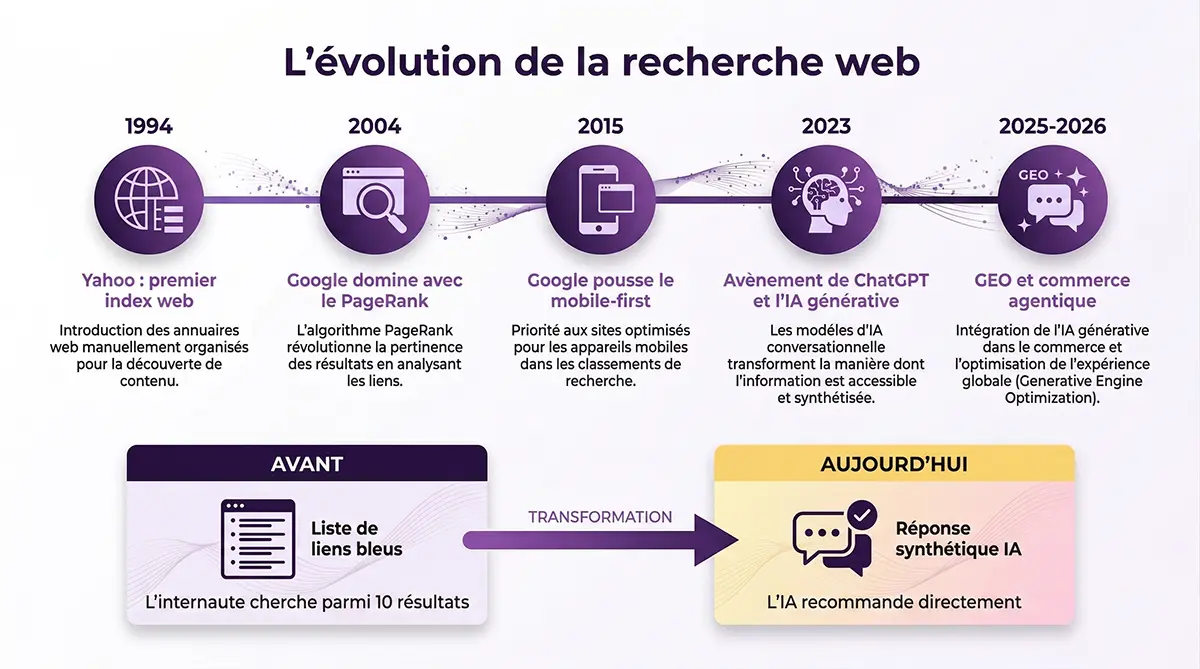

De la liste de liens aux moteurs de recherche génératifs : on ne cherche plus de la même manière sur Internet

Timeline : l'évolution de la recherche web

Jusqu'à récemment, chercher une information sur Internet consistait à interroger un moteur de recherche classique, comme Google dans son format traditionnel. Ce dernier utilisait des algorithmes pour parcourir et indexer le contenu du web afin de trouver et de classer les ressources les plus pertinentes en réponse à une requête par mots-clés. Le résultat ? Une liste de liens bleus que l'internaute devait explorer un par un.

Aujourd'hui, un moteur de recherche génératif est une évolution des moteurs de recherche traditionnels qui s'appuie sur l'intelligence artificielle générative. Ces nouveaux outils, tels que ChatGPT (OpenAI), Gemini (Google), Copilot (Microsoft) ou Perplexity.ai, ne se contentent plus de lister des sites internet. Ils analysent des requêtes complexes formulées en langage naturel, parcourent le web en temps réel, et synthétisent l'information pour fournir des réponses directes, personnalisées et conversationnelles.

L'adoption massive des agents conversationnels

Les chiffres parlent d'eux-mêmes. Si l'utilisation de ces interfaces conversationnelles ne représentait qu'une fraction des recherches il y a quelques années, elle progresse très rapidement. En 2025, le trafic généré par les moteurs de recherche traditionnels a connu une légère baisse (-0,51 %), tandis que le trafic vers les chatbots a explosé de plus de 80 %. Avec 73 % des moins de 35 ans déjà convertis aux agents conversationnels, la question n'est plus de savoir si le GEO mérite une place dans la stratégie de visibilité des marques, mais comment l'implémenter efficacement.

Cette adoption a des conséquences directes sur la façon dont les internautes accèdent à l'information et, donc, sur la manière dont les marques doivent se rendre visibles en ligne. Dans les interfaces génératives, la visibilité n'est plus répartie entre dix résultats : souvent, une seule réponse est lue. L'objectif n'est plus seulement de figurer dans les résultats de Google, mais également d'apparaître dans les réponses des moteurs de recherche IA, réduisant ainsi le besoin de cliquer sur plusieurs liens.

Comparatif du trafic : Moteurs de recherche vs Chatbots IA (Données 2025-2026)

| Plateforme / Catégorie | Visites totales annuelles | Croissance (YoY) | Part de marché (Chatbots) |

|---|---|---|---|

| Moteurs de recherche traditionnels | 1 863 Milliards | - 0,51 % | N/A |

| Ensemble des Chatbots IA | 55,2 Milliards | + 80,92 % | 100 % |

| ChatGPT (OpenAI) | 47,7 Milliards | + 67,09 % | ~ 65 % |

| Google Gemini | 1,7 Milliard | En forte hausse | ~ 21,5 % |

| Perplexity AI | 1,3 Milliard | En forte hausse | ~ 6,3 % |

| Claude (Anthropic) | 1,2 Milliard | En forte hausse | ~ 3,3 % |

Comprendre le fonctionnement des IA : le Search Grounding et le RAG

Pour optimiser sa visibilité, il faut d'abord comprendre comment ces modèles fonctionnent. Contrairement aux idées reçues, un modèle de langage (LLM) ne "sait" pas tout. Il prédit la suite logique de mots en fonction de son entraînement. Pour fournir des informations récentes et fiables, notamment sur des entreprises ou des produits locaux, l'IA doit se connecter au web. C'est ce qu'on appelle le Search Grounding (l'ancrage de la recherche).

Le processus de Retrieval-Augmented Generation (RAG)

Lorsqu'un utilisateur pose une question, le moteur la convertit en un vecteur (embedding) puis recherche dans la base de données vectorielle les vecteurs de documents les plus proches ("voisins les plus proches"). Ainsi, des concepts sémantiquement proches, comme "chiot" et "chien", auront des vecteurs très similaires dans cet espace multidimensionnel. Il ne s'agit pas de traiter les mots-clés comme de simples chaînes de caractères ("strings"), mais de les comprendre comme des objets du monde réel ("things") et de saisir les relations qui les unissent. Le Knowledge Graph (graphe de connaissances) est une autre technologie essentielle qui agit comme le cerveau du moteur de recherche.

Le processus de Search Grounding se déroule en plusieurs étapes clés :

- Compréhension de l'intention : L'IA analyse la question et identifie les entités (lieux, marques, concepts).

- Reformulations (Fan-out) : L'IA génère de multiples requêtes de recherche pour couvrir tous les aspects de la question.

- Recherche web : Ces requêtes sont envoyées à un index web (comme Bing pour ChatGPT ou Google Search pour Gemini).

- Sélection des sources : L'IA sélectionne les pages les plus pertinentes. En moyenne, seules 20 pages sur 100 sont retenues.

- Chunking : Le contenu des pages est découpé en petits morceaux ("chunks") de 200 à 500 tokens. Le format « chunk », en tableaux, listes à puces, questions/réponses courtes, facilite cette extraction.

- Scoring et filtrage : L'IA évalue la pertinence de chaque chunk. Seuls 5 à 20 chunks sont conservés pour générer la réponse finale.

- Génération : L'IA rédige sa réponse en synthétisant les informations des chunks sélectionnés et cite ses sources.

L'enjeu est de répondre non plus seulement à des mots clés, mais aux questions complexes que les internautes posent en langage naturel à une IA. Des réponses détaillées : grâce à une compréhension approfondie du langage naturel, Perplexity AI peut fournir des réponses précises aux questions complexes.

Enfin, Grok (d'xAI) se distingue par son accès en temps réel des données de X (ex-Twitter) et au web, avec un ton humoristique et une capacité à gérer des requêtes complexes via des outils comme la recherche sémantique.

SEO et GEO : une évolution, pas une disparition

Face à ce changement majeur, les entreprises, éditeurs, médias et services en ligne doivent désormais intégrer la Generative Engine Optimization (GEO) à leur stratégie marketing pour maintenir leur visibilité en ligne. La conséquence n'est pas une disparition du SEO, mais une mutation de sa fonction. Le SEO classique reste important, mais les stratégies doivent évoluer pour optimiser la visibilité au sein des réponses générées, ce qu'on appelle aujourd'hui le GEO (Generative Engine Optimization).

Il convient toutefois de préciser que SEO et GEO ne s'opposent pas mais se complètent dans une stratégie marketing globale. L'optimisation pour les moteurs génératifs (GEO) s'inscrit dans son prolongement. Le SEO vise un classement dans une page de résultats (SERP) tandis que le GEO vise une intégration dans une réponse générée par l'IA. Une nouvelle discipline est nécessaire : le GEO désigne l'ensemble des techniques visant à optimiser la visibilité d'une marque auprès des moteurs de recherche basés sur l'IA générative, tels que ChatGPT, Perplexity, Gemini, AI Overviews de Google, etc.

Pour piloter cette visibilité dans les moteurs génératifs, des agences comme Natural-Net utilisent des outils propriétaires et des plateformes comme Partoo ou Datashake qui permettent de monitorer en temps réel le positionnement d'une marque et de ses concurrents dans les réponses de ChatGPT, Perplexity et AI Overviews.

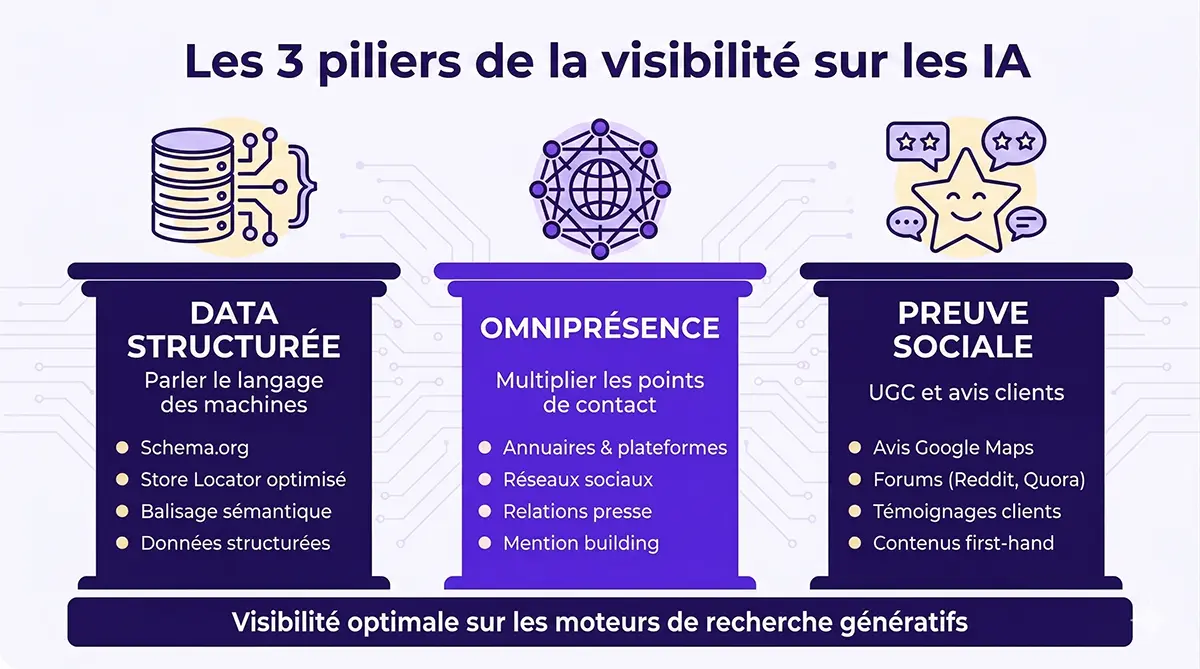

Les 3 piliers pour l'optimisation et rendre votre marque visible sur les IA

Infographie : les 3 piliers pour l'optimisation et rendre votre marque visible sur les IA

Dans le web agentique, une marque n'existe pas simplement parce qu'elle a un site web, mais parce qu'elle est une entité claire, cohérente et confirmée par l'écosystème. La visibilité repose donc sur un ensemble de signaux : prises de parole d'experts, mentions dans la presse, contenus tiers, avis clients, relations sémantiques entre la marque et ses domaines d'expertise. Voici les trois piliers fondamentaux pour y parvenir.

1. La data structurée : parler le langage des machines

Est-il pertinent d'avoir un site web dans l'ère de l'intelligence artificielle ? Oui, plus que jamais, mais son rôle évolue. L'organisation structurée des données sur votre site internet constitue un facteur déterminant pour l'exploitation optimale par les moteurs de recherche IA. Un site web possède désormais un double usage : une interface visuelle pour les humains, et une base de données structurée pour les agents IA.

Cela passe par l'utilisation de données structurées (schema.org) pour qualifier explicitement chaque élément d'une page : « ceci est un prix », « ceci est un auteur », « ceci est une question », etc. Si le format journalistique traditionnel reste prédominant dans la production de contenu, l'intégration de segments conversationnels améliore considérablement l'optimisation pour les moteurs génératifs. La visualisation des données : l'outil intègre des fonctions de visualisation des données, telles que des graphiques et des tableaux interactifs, pour une meilleure compréhension des résultats.

Pour les entreprises locales, l'optimisation du Store Locator est cruciale. Les IA utilisent massivement ces pages pour trouver des informations fiables (horaires, adresses, services). Selon les données de Partoo, les Store Locators représentent jusqu'à 54% des sources citées par les IA pour les agences d'intérim, et 49% pour les agences immobilières.

2. L'omniprésence : multiplier les points de contact

Le processus de "Fan-out" (reformulations multiples) implique que l'IA va chercher des informations sur de nombreux sites différents. Plus votre entité (marque, produit, dirigeant) est mentionnée sur de nombreux sites, plus vous avez de chances d'être cité par les IA. Et plus une marque est mentionnée dans la presse, plus l'IA la considérera comme une référence fiable dans son domaine.

Il faut passer d'une logique de "Link building" (obtenir des liens vers son site) à une logique de "Mention building" (être cité partout). Votre marque doit être présente sur :

- Les annuaires spécialisés et locaux (Google Maps, Pages Jaunes, etc.)

- Les plateformes de votre secteur (TripAdvisor, LaFourchette, Doctolib, etc.)

- Les médias et la presse en ligne

- Les réseaux sociaux (LinkedIn, YouTube, Instagram)

Historiquement, le SEO, le social, le contenu, les relations presse, le produit et le CRM ont souvent été pilotés en parallèle. Aujourd'hui, ces approches ou des approches similaires créent de la pertinence de manière synergique. Disposer d'une fiche Wikipédia ou Wikidata constitue un signal d'autorité très fort pour asseoir votre entité dans le Knowledge Graph.

3. La preuve sociale : le poids des contenus générés par les utilisateurs (UGC)

Les IA recherchent la neutralité et l'objectivité. Pour évaluer une marque ou un produit, elles se tournent massivement vers les contenus générés par les utilisateurs (UGC). Les avis en ligne, notamment sur Google Maps, Trustpilot ou G2, définissent ce que les IA pensent de vous !

Les plateformes sociales offrent exactement ce que recherchent les modèles de langage : des expériences réelles, du langage naturel, et des points de vue contradictoires. C'est pourquoi des sites comme Reddit (10% des citations), LinkedIn (7%) ou YouTube (3,5%) figurent parmi les domaines les plus cités par les LLM. Google Gemini intègre le Knowledge Graph de Google et des capacités multimodales (texte, images, code), avec une emphase sur l'intégration à l'écosystème Google Search, incluant désormais les vidéos YouTube et les posts Instagram dans ses AI Overviews.

Top 10 des domaines les plus cités par les LLM (ChatGPT, Perplexity, Google AI) en 2025-2026

| Position | Nom de domaine | Type de contenu | Part des citations estimée |

|---|---|---|---|

| 1 | reddit.com | Forum / UGC | ~ 10,0 % |

| 2 | linkedin.com | Réseau professionnel / UGC | ~ 7,0 % |

| 3 | wikipedia.org | Encyclopédie collaborative | ~ 7,0 % |

| 4 | medium.com | Articles / Blogs experts | ~ 4,0 % |

| 5 | youtube.com | Vidéos / UGC | ~ 3,5 % |

| 6 | google.com | Écosystème Google (Maps, etc.) | ~ 3,0 % |

| 7 | nih.gov | Institutionnel / Santé | ~ 3,0 % |

| 8 | forbes.com | Média / Presse économique | ~ 2,5 % |

| 9 | amazon.com | E-commerce / Avis clients | ~ 2,0 % |

| 10 | microsoft.com | Institutionnel / Tech | ~ 2,0 % |

Les sources utilisées par les IA selon les secteurs d'activité

L'un des enseignements majeurs des études récentes menées par Partoo et Meteoria est que les types de sources utilisées par les moteurs de recherche génératifs varient considérablement selon les secteurs d'activité. Pour les organisations qui souhaitent optimiser leur visibilité, il est essentiel de comprendre quelles catégories de sources sont privilégiées dans leur domaine.

Répartition des types de sources citées par les IA selon le secteur (Partoo x Meteoria, 2025)

| Secteur | Store Locators | Annuaires | Presse / Plateformes | Autres |

|---|---|---|---|---|

| Agences bancaires | 39 % | 45 % | 10 % | 6 % |

| Supermarchés | 35 % | 32 % | 14 % | 20 % |

| Agences immobilières | 49 % | 7 % | 36 % (plateformes immo) | 6 % |

| Agences d'intérim | 54 % | 17 % | 23 % (plateformes intérim) | 6 % |

Ces chiffres montrent que les Store Locators et les annuaires constituent les deux premières catégories de sources pour les requêtes locales. Pour les entreprises disposant de points de vente physiques, l'optimisation de ces pages est donc un levier majeur de visibilité sur les moteurs de recherche génératifs. Natural-Net accompagne ses clients dans cette démarche, notamment via l'implémentation de Schema.org pour le GEO.

Comparatif SEO vs GEO : ce qui change concrètement

Pour bien saisir la transition entre le référencement naturel classique et l'optimisation pour les moteurs de recherche génératifs, voici un comparatif détaillé des deux approches. Ce tableau permet de visualiser les différences fondamentales dans les comportements de recherche et les stratégies à adopter.

Comparatif détaillé : SEO traditionnel vs GEO (Generative Engine Optimization)

| Critère | SEO traditionnel | GEO (moteur de recherche génératif) |

|---|---|---|

| Format de réponse | Liste de liens bleus (SERP) | Réponse synthétique en langage naturel |

| Objectif principal | Classement dans les résultats de recherche | Intégration dans la réponse générée par l'IA |

| Type de requête | Mots-clés courts | Questions complexes en langage naturel |

| Signaux d'autorité | Backlinks, Domain Authority | Mentions, citations, E-E-A-T, preuve sociale |

| Contenu privilégié | Pages optimisées pour des mots-clés | Contenus approfondis, structurés, vérifiables |

| Mesure de performance | Position dans la SERP, taux de clic | Taux de citation, taux de mention, position dans la réponse |

| Rôle des UGC | Secondaire | Central (avis, forums, réseaux sociaux) |

Ce comparatif illustre bien pourquoi une approche uniquement SEO ne suffit plus. Les signaux d'autorité évoluent : là où le SEO valorisait principalement les backlinks, le GEO s'appuie sur un écosystème de mentions, de citations et de preuves sociales. Pour approfondir cette comparaison, consultez notre article dédié aux évolutions du webmarketing SEO et GEO en 2025 et 2026.

L'importance de l'E-E-A-T pour les moteurs génératifs

Pour être sélectionné parmi les millions de pages web, votre contenu doit répondre aux critères E-E-A-T (Expérience, Expertise, Autorité, Fiabilité). E-E-A-T est un cadre d'évaluation utilisé par Google (et de plus en plus pertinent pour les LLM) pour juger la qualité d'un contenu. Les IA se posent deux questions fondamentales lors de la sélection des sources :

- Authoritativeness : la source fait-elle autorité dans son domaine ?

- Trustworthiness : le contenu est-il fiable et transparent ?

La fraîcheur de l'information est également un critère décisif. Un contenu mis à jour il y a moins de 13 semaines a 50% de chances supplémentaires d'être sélectionné par l'IA lors de la phase de scoring des sources. C'est pourquoi il est essentiel de maintenir vos contenus à jour régulièrement.

Les 4 critères de sélection des sources par les IA

| Critère | Description | Impact estimé |

|---|---|---|

| Autorité de la source | Réputation du domaine, signaux d'autorité, mentions dans la presse et par des organisations reconnues | Élevé |

| Fraîcheur du contenu | Contenus mis à jour depuis moins de 13 semaines | +50 % de chances d'être sélectionné |

| Couverture du sujet | Profondeur et exhaustivité du contenu par rapport à la question posée | Élevé |

| Diversité des points de vue | L'IA favorise les sources offrant des perspectives variées et nuancées | Moyen à élevé |

Pour en savoir plus sur les critères E-E-A-T et leur application concrète, consultez notre guide complet du GEO pour optimiser votre visibilité.

Plan d'action : 5 étapes pour rendre votre marque visible sur les meilleurs moteurs IA

Mettre en place une stratégie GEO efficace ne s'improvise pas. Voici un plan d'action concret en 5 étapes pour structurer votre approche et maximiser votre visibilité sur les moteurs de recherche génératifs.

Étape 1 : auditer votre présence actuelle sur les IA

Commencez par interroger les principaux agents conversationnels (ChatGPT, Gemini, Perplexity, Claude, Copilot) sur votre marque, vos produits et votre secteur. Analysez si vous êtes cité, dans quelle position, et quelles sources sont utilisées. Natural-Net propose un audit complet de visibilité sur les outils IA pour établir un état des lieux précis.

Étape 2 : structurer vos données avec Schema.org

Implémentez le balisage Schema.org sur l'ensemble de votre site internet : LocalBusiness, Product, FAQPage, HowTo, Review, Organization. L'utilisation de données structurées permet aux IA de comprendre sans ambiguïté le contenu de vos pages. Notre guide sur Schema.org pour le GEO détaille cette mise en œuvre.

Étape 3 : créer des contenus optimisés pour les formats IA

Produisez des contenus approfondis, structurés en paragraphes courts avec des sous-titres clairs. Intégrez des données chiffrées, des tableaux comparatifs et des FAQ. Privilégiez un format « chunk » qui facilite l'extraction par les LLM. Pour savoir comment utiliser l'IA pour la rédaction SEO et GEO, consultez notre article dédié.

Étape 4 : développer votre omniprésence et vos mentions

Multipliez votre présence sur les annuaires, plateformes sectorielles, réseaux sociaux et médias. Investissez dans les relations presse pour générer des mentions dans des sources à forte autorité. Chaque mention supplémentaire renforce votre entité dans le Knowledge Graph des IA.

Étape 5 : activer la preuve sociale et les avis clients

Encouragez systématiquement les avis clients sur Google Maps, les plateformes spécialisées et les réseaux sociaux. Répondez à chaque avis pour montrer votre engagement. Les IA analysent la note moyenne, le volume d'avis et leur contenu sémantique pour évaluer la qualité de votre offre.

Vers le commerce agentique : l'avenir de la recherche en ligne

L'optimisation pour les moteurs de recherche génératifs n'est plus une option futuriste, c'est une nécessité immédiate. La Search Generative Experience (SGE) est le nom de l'implémentation par Google d'un moteur de recherche génératif, aujourd'hui déployée sous le nom d'AI Overviews auprès de plus de 2 milliards d'utilisateurs. Elle intègre des résumés générés par IA et un mode conversationnel directement dans les résultats de recherche. Personnalisation des résultats : en se basant sur les préférences et le comportement de recherche de chaque utilisateur, chaque agent conversationnel adapte les résultats pour une expérience plus pertinente.

Demain, nous entrerons pleinement dans l'ère du commerce agentique, où l'IA ne se contentera plus de recommander un produit, mais pourra l'acheter pour vous. ChatGPT Shopping propose déjà une expérience d'achat intégrée avec des questions préliminaires, une sélection de produits et un processus d'achat fluide. Pour que votre marque soit choisie par ces agents, elle doit être structurée, omniprésente et validée par la preuve sociale. Les ressources, le savoir-faire unique et les données gigantesques seront nécessaires pour rivaliser, mais chaque entreprise, à son échelle, peut optimiser sa présence.

Comme le résume Demis Hassabis, CEO de Google DeepMind : « Un web pensé pour les agents n'a plus besoin de pages web ». Cela ne signifie pas que les sites internet disparaissent, mais que leur rôle évolue : ils deviennent des bases de données structurées au service des IA. Le modèle ne se demande plus « quelle page web est la meilleure ? » (SEO) mais « quelle entité est la plus solidement établie ? » (GEO). Les chunks deviennent des votes, les entités deviennent des nœuds de consensus.

Chez Natural-Net, nous accompagnons nos clients dans cette transition majeure depuis les premières heures du GEO. Notre expertise couvre l'ensemble du spectre : audit de visibilité IA, implémentation technique Schema.org, stratégie de contenu GEO, et monitoring des performances sur les moteurs de recherche génératifs. N'hésitez pas à consulter nos autres ressources pour approfondir le sujet :

- SEO pour IA : guide complet du GEO pour optimiser votre visibilité

- Comment être visible sur ChatGPT ? Guide complet du GEO

- Comment être visible sur Gemini : le guide pour le GEO sur l'IA de Google

- Comment être visible sur Perplexity : guide du GEO

- Comment être visible sur l'IA Claude ?

- Comment apparaître dans les résultats de Microsoft Copilot

- GEO local : visibilité des entreprises locales à l'ère de l'IA

- Recherche zéro-clic : le nouveau défi du SEO à l'ère de l'IA

- Du SEO au GEO : présentation et infographie pédagogiques

- Comprendre les nouveaux acronymes : GEO, AEO, AISEO, LLMO

- Guide du GEO LLM par LLM

Foire aux questions

Quel moteur de recherche génératif choisir ?

Le choix dépend de vos besoins. ChatGPT (OpenAI) reste le leader incontesté avec près de 65% du trafic des chatbots. Google Gemini est idéal pour l'intégration à l'écosystème Google et ses capacités multimodales. Perplexity se distingue par son approche axée sur les citations et la recherche académique ou technique. Claude (Anthropic) est réputé pour la qualité de sa rédaction et son analyse de documents complexes.

Quels sont les moteurs de recherche génératifs les plus utilisés ?

En 2026, les moteurs de recherche génératifs les plus utilisés sont ChatGPT (OpenAI) avec plus de 47 milliards de visites, suivi par Google Gemini, DeepSeek, Perplexity AI et Claude (Anthropic). L'adoption de ces outils progresse de plus de 80% par an, transformant les comportements de recherche des internautes.

Que sont les moteurs de recherche génératifs ?

Un moteur de recherche génératif est une évolution des moteurs de recherche traditionnels qui s'appuie sur l'intelligence artificielle générative (LLM). Au lieu de fournir une simple liste de liens bleus, il analyse l'intention de l'utilisateur, parcourt le web (Search Grounding), sélectionne les sources les plus pertinentes et génère une réponse synthétique, personnalisée et conversationnelle en langage naturel.

Quelles sont les intelligences artificielles génératives les plus utilisées ?

Outre les LLM textuels comme ChatGPT, Gemini ou Claude, les intelligences artificielles génératives les plus utilisées incluent Midjourney et DALL-E pour la création d'images, Runway et Sora pour la vidéo, ainsi que des outils spécialisés comme GitHub Copilot pour le code. Ces capacités multimodales enrichissent considérablement les résultats de recherche.

Est-il pertinent d'avoir un site web dans l'ère de l'intelligence artificielle ?

Oui, absolument. Bien que les agents conversationnels génèrent des réponses directes, ils ont besoin de sources fiables pour alimenter leur base de connaissances (RAG). L'organisation structurée des données sur votre site internet constitue un facteur déterminant pour l'exploitation optimale par les moteurs de recherche IA. Votre site devient une base de données structurée pour les LLM.

Quel est l'impact des moteurs de recherche génératifs sur le trafic généré sur les sites web ?

L'impact des moteurs génératifs sur le trafic web reste modéré mais en progression constante. Les données actuelles montrent que moins de 20% des recherches passent par ces nouvelles interfaces, générant environ 1% du trafic total vers les sites internet traditionnels.

Notre agence Natural-Net observe que les secteurs B2B et techniques maintiennent des taux de clic plus élevés depuis les réponses IA, car les utilisateurs recherchent des informations approfondies. Les moteurs génératifs créent un nouveau type de trafic qualifié : moins volumineux mais plus ciblé, avec des visiteurs ayant déjà une compréhension précise de leurs besoins.

Cette transformation progressive modifie la nature du trafic organique plutôt qu'elle ne le supprime, créant de nouvelles opportunités pour les entreprises qui adaptent leur stratégie de contenu.

Existe-il un classement des meilleurs moteurs de recherche génératifs ?

Plusieurs études indépendantes établissent des classements basés sur différents critères de performance. ChatGPT d'OpenAI domine largement avec 47,7 milliards de visites annuelles et 65% de part de marché des chatbots IA.

Google Gemini occupe la seconde position avec 1,7 milliard de visites, suivi par Perplexity AI (1,3 milliard) reconnu pour la qualité de ses citations, et Claude d'Anthropic (1,2 milliard) apprécié pour l'analyse de documents complexes. Les critères d'évaluation incluent la précision des réponses, la vitesse de traitement, l'interface utilisateur et la fiabilité des sources citées.

Notre agence Natural-Net recommande de tester plusieurs plateformes selon vos besoins spécifiques : recherche académique, analyse multimodale ou intégration d'écosystème.

Sources et références sur le référencement GEO

- Partoo, Conférence AI SCOPE 2 : "Dans la tête des LLMs : Comment les IA choisissent vos marques", 2025.

- Semrush, "Top Cited Domains on LLMs (ChatGPT, Google AI Mode, Perplexity )", Étude sur 230 000 prompts, Octobre 2025.

- WordStream, "34 AI Overviews Stats & Facts", Février 2026.

- Stackmatix, "Best AI Search Engines in 2026: 8 Platforms Compared", Mars 2026.

- FirstPageSage, "ChatGPT Usage Statistics & Market Share", Avril 2026